2. 先进飞行器导航、控制与健康管理工业和信息化部重点实验室, 南京 211106;

3. 卫星通信与导航江苏高校协同创新中心, 南京 210016

2. Key Laboratory of Navigation, Control and Health-Management Technologies of Advanced Aerocraft, Ministry of Industry and Information Technology, Nanjing 211106, China;

3. Satellite Communication and Navigation Collaborative Innovation Center, Nanjing 210016, China

动物具有优秀的(群体)导航能力,可实现由原始感知信息的输入到准确、可靠、灵活的导航动作的直接输出,这种端到端的智能行为,一直是人工智能(AI)研究领域持续关注的焦点之一。近年来,随着脑与神经科学的不断发展,研究者逐渐揭示了昆虫和哺乳动物及其群体大脑导航机理[1-3],受这些机理启发,以及AI所依赖的智能算法、计算能力和数据的发展,一种新型仿生导航技术“类脑导航”得到了较大发展,展现出了自主环境感知、空间认知、面向目标导航(路径规划与动作决策)一体化智能计算能力,在自主智能无人系统中具有较大的应用潜力。

无人机密集集群作为无人系统的主要形式之一,是由成百上千甚至更多无人机个体通过某种特定集群机制所形成的一类高度可重构、按需设计、分布式自主智能的密集网络化无人系统,在充分发挥数量优势的情况下,可以提供显著增强的任务执行能力、灵活性和鲁棒性,在侦察、搜救、飞行表演、测绘测量等军民用领域具有广阔的应用前景[4]。但同时无人机密集集群庞大的网络化群体结构和复杂飞行环境也对集群导航技术提出了特殊要求:能适应卫星不可信、电子干扰、夜间等复杂飞行环境(鲁棒性);能在配备低成本导航设备前提下实现准确的导航精度(准确性);感知与导航信息能及时生成动作决策而快速响应复杂外部环境及密集集群环境(实时响应动作);应有较高的自主智能性(智能性);通过少量无人机个体的导航信息交互即能实现整个集群导航的能力(计算效率)。现有无人机集群导航算法难以较好或同时满足上述需求[5-7],亟需发展能适应无人机密集集群复杂飞行环境的鲁棒性强、准确、实时响应动作、智能性强以及计算量小的新型集群导航方法。

类脑导航技术具有解决上述无人机密集集群导航难题的潜力。其中,基于昆虫导航机理的多模态仿生传感器和哺乳动物导航机理的类脑传感信息处理机制的类脑环境感知技术具有低成本、多模态测量优势,可以在复杂作业环境下提供准确的环境及个体运动信息;哺乳动物导航机理启发的导航细胞自组织神经计算机制的类脑空间认知技术,不依赖高精度传感器和准确导航模型,可以提供较为准确可靠的导航参考;哺乳动物导航机理启发的端到端面向目标类脑导航技术,无需导航参数解算,可实时耦合原始感知、认知与动作决策;类脑导航技术架构具有较好开放性,可以扩展更多类脑智能行为;昆虫个体以及哺乳动物导航细胞自组织行为启发的类脑群体导航技术,仅通过与局部群内或与环境的相互信息交互既可在整个群体层面涌现有序的协同行为。

类脑导航技术的上述特点与无人机密集集群系统对集群导航鲁棒性、准确性、实时响应动作、智能性以及计算效率的要求有着紧密的契合之处,是实现无人机密集集群导航鲁棒性强、准确、实时响应动作、智能性强以及计算量小等要求的一条新思路和途径。本文基于作者团队申请并主持的国家自然科学基金项目“类脑感知定位机理的无人机密集集群编队协同导航方法(61873125)”研究进展,对呈现上述特点的类脑导航技术研究现状、研究新趋势以及存在的问题和挑战进行了详细论述。

本文作者团队曾综述分析并发表了无人机集群类脑导航系统[8]一文,但本文与前文论述的主题和方法不同,前文着重分析了一类仅计算输出导航与相对导航参数(姿态/速度/位置)的脑启发导航模型;而本文阐述了类脑导航技术最新研究进展,研究了另一类直接输出动作决策的感知/认知/路径规划/动作决策一体化类脑导航智能体,本类方法在实时响应外界环境并自主生成动作决策方面有潜在的优势。

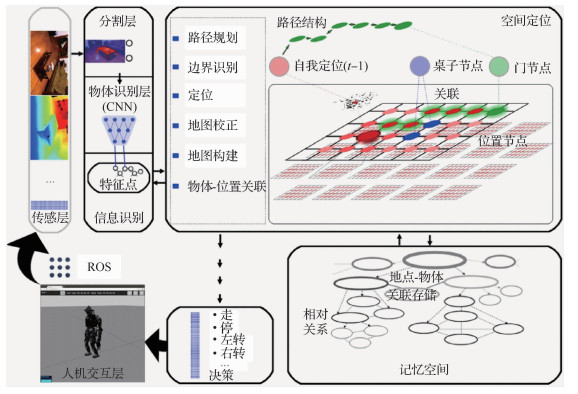

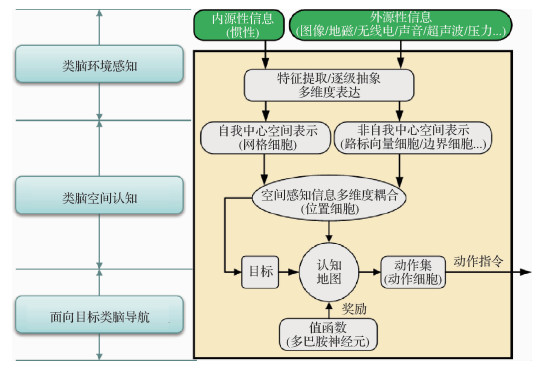

1 类脑导航技术 1.1 动物大脑导航机理认知地图是动物进行空间认知和导航的基础。昆虫将与其他个体以及环境交互过程中形成的认知地图存放于外部环境中,如蚂蚁通过在环境中释放的信息素的铺设和跟踪来建立正常交通的路线和网络,这些路线和网络构成了蚂蚁的认知地图[9];而哺乳动物的认知地图则位于大脑的海马区中,该脑区中多种导航细胞实现对环境信息的编码和记忆,形成表征空间的内部认知地图。昆虫/哺乳动物形成认知地图或基于认知地图进行导航的机理如图 1所示。

|

| 图 1 动物大脑端到端导航机理 Fig. 1 Mechanism of end-to-end navigation of animal brain |

1) 昆虫大脑导航机理

昆虫同时采用非自我中心和自我中心2类信息组合定向[1]。非自我中心主要有:复眼感知太阳方位/光线强度与光谱梯度;复眼高度专化的小眼感知天空偏振光进行定向;触角感受气味/风向等信息进行相对定位,并敏感地球磁场定向。自我中心信息为内部体感的角速度。昆虫大多利用光流进行测速,积分获得距离信息,而步行蚂蚁等昆虫使用步进积分器来估计行进距离。然后对方位和行进距离路径积分定位。昆虫通过复眼观测全景视图、触角感受气味等信标进行信标定位。使用复眼视觉快照(Snapshot)等信标,通过最大化当前和记忆信标之间的匹配,沿着图像差异最小的信标方向进行路线跟随[1]。

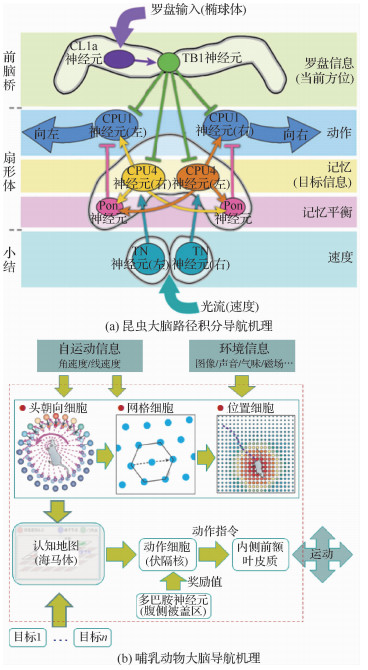

中枢复合体(Central Complex)被认为是昆虫导航与控制的关键脑区,主要由扇形体、椭球体、前脑桥和一对小结构成[1]。当前主要揭示了中枢复合体的路径积分导航神经机制,如图 1(a)所示。椭球体神经元实现对非自我中心和自我中心方位传感信息的融合,融合后的方位信号投射到前脑桥中,激活编码某一方位的特定神经元,以此表征昆虫方位。小结接收光流速度信息并投射到扇形体中循环连接的神经元,循环神经元结合前脑桥编码的方位信息在这里完成路径积分。当前时刻的定位定向信息不断与小结记忆中的目标方位位置进行比对,比对结果产生误差信号驱动特定动作神经元产生动作指令。

2) 哺乳动物大脑导航机理

哺乳动物导航能力以大脑内嗅皮层——海马体(海马区)中的大量导航细胞集群放电活动为基础,通过大量导航细胞(神经元)形成的神经回路进行导航和定位计算,是大脑神经网络多层级信息编码和表征的结果。海马区中的3种关键导航细胞为头朝向细胞、网格细胞、位置细胞,如图 1(b)所示。哺乳动物经过长期导航行为学习和发育,形成上述3种导航细胞特定的突触连接结构,进而构成大脑导航神经网络计算回路呈现出:在大脑前庭系统角速度输入或视觉信息转化的角速度输入下,特定的头朝向细胞会放电激活,以此表征方位信息;网格细胞对自运动信息(头朝向细胞提供的方位输入和速度细胞提供的动物前向速度输入)进行路径积分,并在动物到达环境中六边形网格状区域顶点时激活放电,对局部空间进行不同分辨率和方向的度量,形成高效紧凑的空间度量地图,被用来为空间中任意位置提供矢量导航[10];多尺度网格细胞路径积分的结果融合产生位置细胞特定的放电活动[11],动物到达环境某个区域时,特定的位置细胞会激活放电,以此指示动物所处位置及周边空间信息,大量位置细胞联合编码所处整个环境,形成表征环境的内容认知地图,但由于路径积分存在累积误差,上述生成的认知地图不准确;此外,图像、声音、气味等外部环境信息也会激发特定位置细胞放电,形成对特定环境区域的记忆,通过大量位置细胞的联合记忆也能生成认知地图,但此时的认知地图是离散的片段式;最终,位置细胞通过融合外部信息和路径积分信息生成准确连续可靠的认知地图[12]。头朝向细胞、网格细胞以及位置细胞神经计算回路中还存在其他多种导航细胞,完成对导航信息不同层级的神经计算[13]。

大脑中的海马体和内侧前额叶皮质被普遍认为是处理动物面向目标导航的2个关键脑区[14],如图 1(b)所示,伏隔核一方面接收海马体产生的空间认知信息,另一方面从腹侧被盖区接收由多巴胺神经元产生的奖励预测误差信息(即当前与目标位置间的误差),然后融合此二种信息并通过伏隔核中的动作细胞产生一系列动作指令,内侧前额叶皮质接收动作指令指导动物的运动行为,最终完成面向目标的导航过程。

上述昆虫和哺乳动物大脑导航机理表明:二者都是通过大脑内部多种大量导航细胞(神经元)自组织集群特异性放电活动对自运动以及视觉/听觉/嗅觉等外源性输入信息进行端到端导航神经计算的,均包括3个过程:路径积分、信标校正以及面向目标导航;二者导航过程均可以抽象为3个阶段:环境感知、空间认知、面向目标导航;此外,昆虫通过大量昆虫个体的自组织集群形成群体智能,而哺乳动物通过导航细胞的自组织集群形成产生空间智能的海马区和内侧前额叶皮质结构,具有互补对称性[9]。

1.2 类脑导航技术概念类脑导航是一种动物大脑端到端导航机理启发的新型仿生导航技术,如图 2所示,以自运动等内源性、视觉等外源性信息为输入,借鉴动物感知、认知和导航脑区结构和信息处理机制,利用AI技术实现从原始感知信息输入到导航行为决策的直接输出,形成具有自主环境感知、空间认知、路径规划与动作决策一体化能力的智能体。类脑导航不仅隐含了导航参数解算,更实现对环境信息的学习、推理、探索、记忆等认知过程以及综合任务目标做出的路径规划与决策。

|

| 图 2 类脑导航工作流程 Fig. 2 Workflow of brain-inspired navigation |

类脑导航包括类脑环境感知、类脑空间认知以及面向目标类脑导航3个过程。类脑环境感知借鉴动物感知环境方式和处理多感官信息的选择性注意、逐级抽象等神经机制,采用卷积神经网络等AI技术实现对多模态传感信息的多维度特征提取并解析自运动信息及环境信息;类脑空间认知借鉴大脑导航细胞自组织集群放电机制,采用吸引子神经网络等AI技术构建空间认知模型,将自运动信息和环境信息转化为表征自身导航信息及环境特征事物关系特征的导航细胞特异性放电活动,构建认知地图;面向目标类脑导航借鉴动物面向任务目标位置导航行进时认知地图特定导航细胞与动作细胞连接激活神经机制,采用强化学习等AI技术实现面向目标位置的路径规划与动作决策过程。

2 类脑导航技术研究现状 2.1 类脑环境感知动物具有多种精致巧妙的感觉器官以及感官信息处理机制,这些是动物实现准确、高效感知自身运动、同伴以及周围环境信息的关键。类脑环境感知主要研究借鉴动物丰富的视觉、触觉、嗅觉、听觉等多种感觉器官生物结构及其多模态感官信息处理机制,实现对载体自身导航信息以及周围环境多维度特征提取。其中基于昆虫感觉器官的仿生传感器以及基于哺乳动物大脑感官信息处理机制的选择性注意、逐级抽象等类脑环境感知神经计算方法得到了大量研究。

2.1.1 多模态仿生导航传感器当前研究使用较多的仿生类导航传感器主要有光学类、电磁学类、力学类。

1) 光学类。基于昆虫复眼结构的复眼传感器可以实现高分辨率大视场成像;利用复眼结构中众多子眼形成的视差及方位感知能力,实现目标三维定位;还可以感知天空偏振矢量场信息获得导航能力。基于昆虫视网膜感受像素强度视域变化的机制的光流传感器不仅包含了运动信息,还包含有关景物三维结构的丰富信息。同样基于动物视网膜感光机制启发的事件相机通过异步方式测量每个像素亮度变化实现对时间/位置和符号进行编码,相比传统以固定速率捕获图像视觉传感器具有高动态范围、高时间分辨率、低功耗、不受运动模糊影响等优势[15]。

2) 电磁学类。蝙蝠通过发出超声波不仅可以探测物体距离、方向和运动速率,还可以判断其大小、形状和结构[3],基于该原理的超声波传感器/雷达计在导航、避障等方面得到了大量应用。

3) 力学类。基于昆虫平衡棒(Haltere)感知角运动机理的仿生陀螺仪具有抗震性强、受温度影响小等优势。基于动物触觉感知物体材质、空间属性机理的仿生触觉传感器可以进行物体空间、物体感知,弥补视觉传感不足,实现对环境的精细感知,如加州大学伯克利分校[16]开发了基于深度学习/触觉传感器的“深度触觉模型”,实现机器人通过触觉信息精确定位物体,进一步融合视觉/触觉,实现视觉粗略感知、触觉精细感知;此外,也可以以自我中心和非自我中心为参考系感知自身或物体空间位置[17],如普渡大学[18]制造了仿生蜂鸟飞行机器人,采用类脑导航算法仅依靠触觉传感信息实现在黑暗条件下像蜂鸟一样自行飞行与避障。

此外,融合使用上述多模态传感器,可以感知获得更加丰富的不同尺度层级的环境及自运动信息。加州大学伯克利分校[19]为美国国防高级研究计划局(DARPA)研究设计了仿昆虫轻量微型无人机硬件平台,同时集成了仿生复眼、昆虫平衡棒仿生陀螺仪、仿生光流传感器、U型仿生磁强计等多模态仿生传感器,具有环境感知信息丰富、动态飞行环境适应性强、测量准、节能等多种优势。基于蜜蜂视觉机理和导航方法的光流计算模型[20],通过感知测量图像多维度运动和光流场进行导航,相比传统视觉法具有简单、鲁棒性强等优势,已用于多种自动导航系统研制,如基于光流导航与复眼结构结合的仿生微型室内飞行器[21]。此外,也能进一步融合声音[22]、气味[23]等其他模态仿生传感信息用于感知环境和自身运动信息。

2.1.2 类脑传感信息处理面对海量传感信息,借鉴动物感官信息处理机制,快速准确实现对场景感知、目标识别与特征提取是类脑环境感知需解决的另一重要问题。

动物是以全景信息为基础进行视觉信息处理。动物在处理视觉信息时,首先对原始全景图像进行压缩,压缩后的低分辨率图像信息仍包含丰富的导航信息,用于视觉匹配、运动状态检测等,这种视觉处理方式相比视觉特征点提取具有更强的鲁棒性[24]。此外“快照模型”提供了有效的根据当前经历的信标视图信息和记忆视图之间的匹配度进行视觉导航指引的方法[25]。

动物以选择注意机制、逐级抽象机制处理海量感官信息。作为降低图像数据处理复杂度的重要预处理步骤,基于视觉注意机制的图像视觉显著性区域检测技术发展迅速,有效解决了传统对图像数据所有区域不设优先级的处理方法造成了大量的计算浪费问题[26]。受Hubel和Wiesel[27]关于初级视觉皮层定向选择性的研究以及近几年逐渐发展的深度学习的启发,基于生物视觉神经元局部感受野机制的擅长处理连续输入信号的卷积神经网络(CNN)被提出,在环境快速感知和目标识别领域得到了大量应用。用CNN来研究从大量感觉输入中快速分层提取有用特征并逐级抽象,在单目视觉深度估计任务中得到了成功应用[28],谷歌DeepMind提出了一种抽象视觉定位方式,省去以点云或像素的形式构造显式地图,而是在更高、更抽象的级别(如对象级别)学习环境的隐式表示[29]。苏黎世联邦理工学院[30]结合CNN和路径规划控制系统,将无人机实时感知的原始图像抽象映射为路点和期望速度形式的鲁棒表示,实时耦合无人机感知与动作。此外,还有如基于拓扑知觉理论的前馈式层级识别模型[31]等其他大脑视皮层生物启发的视觉信息处理方法。

2.2 类脑空间认知类脑空间认知通过大脑导航细胞的自组织集群放电活动实现对类脑环境感知过程提取的自运动信息(方位/速度)以及解析的环境信标信息的导航解算,并将导航信息转化为大脑内部特定的导航细胞放电活动,同时将解算的位置信息与信标信息通过位置细胞关联记忆和存储,完成认知地图的构建。其中导航细胞自组织集群放电活动的神经计算是类脑空间认知的基础,其神经实现和计算机制一直是一个开放性问题,当前模型主要有:连续吸引子神经网络(CANN)、深度学习模型、脉冲神经网络模型。上述模型,均是基于神经网络中大量导航细胞的集群放电活动涌现的;另一类是基于单个导航细胞模型,如振荡相干模型[32]、贝叶斯大脑模型[33],此类模型认为空间认知信息的计算在单个导航细胞计算实现,然后通过干涉或加权融合得到全局统一的导航信息进一步形成认知地图。本文重点对基于导航细胞集群放电机制的连续吸引子神经网络、深度学习模型、脉冲神经网络模型进行分析。

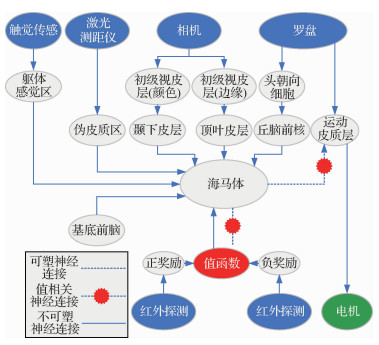

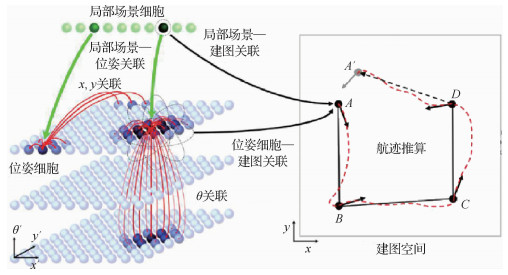

2.2.1 连续吸引子神经网络模型CANN是一种具有特殊网络连接结构的循环神经网络,认知神经科学研究表明CANN刻画了大脑信息处理机制的本质特征,是神经信息表达的典型计算模型,其内部神经元集群放电活动具有高效、稳定、平滑的参数化记忆编码信息的能力。CANN的上述特性与哺乳动物大脑导航细胞集群放电表征动物导航参数尤为切合,已成功应用于建模头朝向细胞、网格细胞以及位置细胞神经计算模型,具有很强的生物意义和工程应用前景。代表性的研究如Burak和Fiete提出的CANN网格细胞精确路径积分模型,接近神经生理学观察的大鼠网格细胞路径积分保持精度[34]。Milford团队基于鼠脑头朝向细胞和位置细胞神经计算机理的RatSLAM系列视觉仿生即时定位与建图(SLAM)算法[35],如图 3所示,可以从较弱的视觉输入信息构建大型和复杂区域认知地图,并基于低成本视觉传感器进行了66 km郊区建图、连续运行2周的室内机器人建图。基于CANN的类脑空间认知方法得到了大量研究和应用,详细内容可查阅文献[13]。

|

| 图 3 RatSLAM算法 Fig. 3 RatSLAM algorithm |

采用递归CANN描述位置细胞、网格细胞等导航细胞作用机理时,表现出较好的模型适用性[34]。然而,这些模型通常依赖于合适的突触权值,同时这些权值需要呈现出一种特定不对称连接形式,以便根据自运动信息来移动吸引子状态。这些特殊的连接形式是否真实存在于动物大脑中目前尚不清晰。此外,CANN主要考虑了少数几种导航细胞作用机制,而未包含可能存在的其他类导航细胞。为全面地模拟海马-内嗅皮层导航机理,需要建立一个完备的模型以能够同时包含其他导航细胞以及神经生理学机制。而近年来功能不断发展的深度循环神经网络(RNN)在上下文相关或时序相关的自然语言、语音等数据处理中得到了广泛研究与应用,具有较好地融合当前输入与过去历史的特性以及类脑处理复杂空间认知导航问题的潜能[36],是减小CANN模型不完备性的一条途径。图 4为哥伦比亚大学[37]利用RNN训练速度和航向输入完成了模拟二维导航任务,在对训练好的RNN网络节点进行可视化操作时,呈现出了与神经生理学观察一致的网格细胞、边界细胞和条纹细胞等导航细胞放电表示样式。同时,谷歌DeepMind团队[38]在用RNN中的长短期记忆网络(LSTM)训练速度和航向信息时也呈现出了网格细胞放电样式,此外,还证明了网格细胞等导航细胞支持矢量导航的观点。上述两项最新发现,证明了把RNN用于空间的定位和导航时,隐节点的物理意义类似于大脑位置细胞、网格细胞、边界细胞等导航细胞。

2.2.3 脉冲神经网络模型基于脑启发的脉冲神经网络(SNN)模型相比基于数学理论推导的CANN、深度学习等人工神经网络模型更加接近实际生物结构,其神经元的输出具有时间维度编码的脉冲序列,多个神经元可以实现时-空二维空间的表达能力。基于SNN的类脑空间认知模型大部分连接由大脑结构预先定义,只需较少的参数学习就能较好建模位置细胞、网格细胞、头朝向细胞等大脑导航细胞集群编码导航信息,实现映射环境[39]。此外,把大脑模仿成神经处理的层级结构,初始阶段不建立神经元全连接,通过将识别的环境成分映射到有限数量的神经表征中,从而学习认知未知环境区域,同时使学习需求最小化[40]。但SNN主要采用依赖神经元脉冲时序而定的可塑性进行网络参数学习,是一种局部训练的非监督非反向传播算法,但不能保证一定能训练出性能优异的网络,另外,SNN网络训练比较困难,因此基于SNN的类脑认知模型还处于初级研究阶段。

2.3 面向目标类脑导航面向目标类脑导航通过无监督学习建立认知地图中表征方位、位置、障碍物等多种导航信息的头朝向细胞、位置细胞、边界细胞等多种导航细胞与表征多种动作行为的多种动作细胞之间的智能神经连接,完成由原始环境感知信息输入到动作决策的直接输出过程,实现接近动物端到端面向目标导航的智能行为,如图 5所示。无监督学习通过让机器人自主探索面向目标导航任务,自主加强特定导航细胞与特定动作细胞的突触连接强度,最终形成一种稳定的连接模式,在这种连接模式下,导航细胞的每种放电状态都对应一种特定的最优的动作细胞,实现面向目标的导航过程。代表性的研究如用赫布学习建立头朝向细胞/位置细胞与动作细胞的智能连接,实现机器人自主面向目标行进导航[41];采用网格细胞对当前和目标位置分别进行多尺度空间编码,通过竞争学习建立当前和目标差异与运动神经元的特定连接,实现了机器人紧凑的面向目标导航过程[42];在矢量导航框架下,通过奖励机制和关联学习实现机器人面向目标导航路径自主优化决策,以动物抄近路方式到达目标[43]。无监督学习类面向目标类脑导航具有自主学习导航行为决策的优势,灵活性较强,缺点是学习效率较低,效果有限。

|

| 图 5 基于无监督学习的面向目标导航 Fig. 5 Unsupervised learning-based goal-directednavigation |

CNN为从大量感觉输入中快速分层提取有用特征提供了一种可行的方式;深度学习的发展,为强化学习在大规模决策问题中的应用提供了可能。这些研究促进了另一类面向目标导航“深度强化学习导航”的发展。深度强化学习导航将深度学习的感知能力和强化学习的决策能力相结合,并能够通过端到端的学习方式快速实现从原始图像输入到导航行为决策的直接输出,建立起感知与行为决策之间的智能连接,在最大化策略函数的过程中实现了智能体的导航过程,是一种更接近动物思维方式的端到端的面向目标导航方法。深度强化学习导航在3D游戏[44]、迷宫[45]、室内[46]等场景仿真中取得了较好效果,甚至表现出了超越人类的能力。

深度强化学习导航对于游戏等这种复杂的、每步行为之间存在较强相关性的、通过短期的奖励即可得到最优的策略的环境有很好的效果,但是对于奖励稀少,需经过长期奖励才能获得最优策略的导航场景,很难快速学习出最优策略,可通过引入多源感知信息构造奖励数量[45]、对记忆场景的复用[47]增加奖励数量等手段缓解因奖励过少而引起的寻优过慢及习得策略不优等问题。深度强化学习导航应用前需进行大量试错式迭代训练,大多载体在应用时一般很难承受如此多的试错,也很难在实际场景中进行训练。解决训练难题一方面可通过充分利用已有经验加快和加强新任务的学习,如在线元学习[48],基于类似场景下可控载体采集的数据进行技能训练[49];另一方面通过开发环境模拟器,在虚拟场景中进行训练[50],但仿真场景和真实场景存在较大差别,训练出来的模型不能很好地泛化到真实场景中。此外,还可以引入迁移学习机制,提高模型通用性,如谷歌DeepMind团队[51]构建的双路径深度强化学习导航架构,用两路RNN来分别记忆不同环境下通用的导航寻路策略内核和不同环境下位置的重新表征,进一步通过CNN实时提取视觉输入,实现了在没有地图库参考、仅给出几个地标点(任务奖励)情况下,成功在离线街景中到达目的地。该深度强化学习导航的主体“导航寻路策略”还具有在不同城市间的迁移能力。

3 类脑导航研究新趋势当前,国内外研究者从类脑环境感知、类脑空间认知以及面向目标类脑导航等3个方面开展了类脑导航研究,初步形成了机理分析、建模、仿真与实验验证一体化的研究体系,表现了一定类似动物的自主智能特性,但还存在着智能水平欠佳、模型不完整、实时性差等问题,尚处于探索和完善阶段。当前,研究人员通过扩展类脑导航与更多类脑智能行为的耦合,尝试实现类脑导航神经形态软硬件一体化设计,通过集群机制促进类脑导航向类脑群体导航发展,进一步提高类脑导航自主智能性。

3.1 类脑导航智能化动物进行空间认知和导航时利用了包括感官信息激发位置细胞放电、空间记忆和推理在内的多种并行机制[52]。现有类脑导航研究主要从自运动信息和视觉2个信息源模拟动物大脑导航过程,忽略了记忆、推理等其他机制的作用,无法从系统层面模拟大脑导航机制。事实上,海马-内嗅皮层中的位置细胞-网格细胞回路在编码地理位置信息的同时,还进行编码记忆声音频率,物体形状及其他抽象的任务特征空间[53],位置细胞-网格细胞的功能可能比在地理环境中进行定位要更加广泛,如图 6[52]所示。人和动物进入新环境时,仍表现出高效准确的认知导航能力,与大脑基于记忆的推理能力息息相关[54],如基于网格细胞的视觉识别、记忆和推理模型[55]。因此,如何共用位置细胞-网格细胞神经回路,将类脑导航与记忆、推理、知识空间或语义空间等更多智能行为耦合,产生更强大的类脑导航能力,是未来研究热点,如基于类脑导航机制和情节记忆的服务机器人[56]。

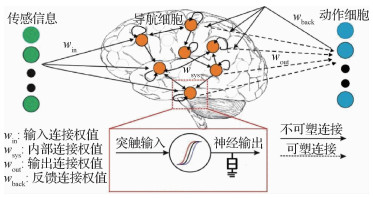

3.2 类脑神经形态导航系统当前,国内外主要从软件算法层面开展了类脑导航技术研究,具有一定的自主智能及鲁棒性。但由于当前类脑导航算法实现过程主要还是基于CPU平台的冯·诺依曼计算体系结构,存在模型复杂、计算量大、实时性差、功耗高等弊端[11]。实际上,动物大脑高效、准确、实时的导航能力还与神经生理结构密切相关,类脑导航研究还需考虑硬件智能的设计。如何借助基于脉冲神经网络的神经形态技术,将软件智能与硬件智能二者优势有机融合,从结构层次模仿脑、器件层次逼近脑智能层次超越脑,建立更强大的类脑导航系统,实现类脑导航软硬件一体化,是实现更深层次模拟动物导航面临的关键问题和挑战,也是未来应用于无人载体研究的重点。美国诺贝尔生理医学奖获得者Edelman团队提出了类脑导航系统软硬件一体化设计架构“BBD”(Brain-based Device)[57],如图 7所示,包含了从传感信息输入、类脑认知地图构建、行为决策、行进导航以及运动控制全过程,为类脑神经形态导航系统的设计提供了较好的范例。

谢菲尔德大学[58]“Brain on Board”项目基于昆虫复眼视觉开发了类蜜蜂脑软硬件架构四旋翼无人机平台BeeBotV2,具有体积小、能耗低等优势。加州大学欧文分校[59]首次采用SNN架构类脑芯片TrueNorth实现了基于CNN的无人驾驶小车野外自主导航、决策与控制一体化测试,具有硬件体积小、功耗低、并行计算等优势;曼彻斯特大学采用其SNN架构类脑芯片SpiNNaker实时解析视觉信息实现了机器人全自主导航与行驶。苏黎世联邦理工学院Yulia团队[60]设计了基于SNN的SLAM算法,并在混合模拟/数字神经形态硬件平台进行了测试实现了较好的时间复杂性和节能;苏黎世联邦理工学院[61]开发了微型无人机计算平台用简化CNN类脑视觉环境感知与飞行动作决策一体化算法,并基于ASIC超低功耗AI芯片Gap8设计了类脑导航计算机,实现了27 g微小无人机全自主智能飞行。近期,清华大学设计开发了基于“天机”混合异构类脑芯片的软硬件一体化计算平台[62]。通过共用树突回路,融合了基于精确多位值处理计算信息机制的人工神经网络硬件计算回路和基于二进制脉冲序列的神经形态硬件计算回路;采用神经状态机算法融合了基于视觉、语音、IMU传感信息的CNN、SNN、CANN等多模态神经计算回路,实现了无人驾驶自行车自平衡、动态感知、目标探测、跟踪、自动避障、语音理解、自主决策等功能。上述研究为发展自主环境感知、空间认知、路径规划与动作决策一体化能力的类脑神经形态导航系统及其工程应用奠定了基础。

3.3 类脑群体导航自组织行为是自然界中常见的现象,如协同工作的蚁群和蜂群、编队飞行的鸟群和蝙蝠群、结队巡游的鱼群等。这些现象的共同特点是一定数量的自主个体通过局部群内以及与环境的相互交互和通信,在整个群体层面上呈现有序的协同样式和行为。上述自组织机制为实现类脑导航从个体智能导航到群体智能导航产生提供了一个很好的生物模型。当前研究人员主要借鉴昆虫以及蝙蝠等哺乳动物个体自组织机制以及哺乳动物个体大脑导航机理启发的导航细胞自组织机制开展了部分集群类脑导航研究。

1) 生物个体自组织机制

昆虫通过与环境以及其他昆虫个体的自组织信息交互完成群体导航过程。其中昆虫通过向环境释放某种吸引或排斥物质来建立正常交通的路线和网络,这些路线和网络构成了昆虫的认知地图,代表性的研究如Jimenez等[63]基于蚂蚁正反馈和负反馈信息素集群认知地图构建机制,采用SNN在Netlogo多智能体仿真验证平台实现了机器人集群认知地图的高效准确构建和自组织机制的机器人群体智能导航。Bonnet等[64]研究了蜂群和鱼群通过视觉信号(如不同的形状、颜色和条纹)和行为信号(如加速度、振动和尾巴运动)进行个体导航信息传递交互机制,通过机器人协助实现鱼群和蜂群跨物种协同集群飞行。

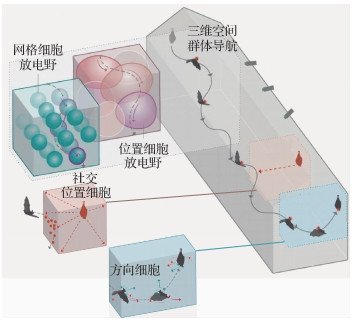

哺乳动物同样通过与环境以及其他个体的自组织信息交互完成群体导航过程。近两年来,认知神经学家开始探索以蝙蝠群体为代表的哺乳动物群体导航机理[65],如图 8所示。当前被证实的蝙蝠群体导航神经元[66-67]:敏感空间位置的三维位置细胞,敏感空间角度的三维方向细胞,敏感行进距离的三维网格细胞,以及追踪临近事物运动轨迹和感应同伴位置的社交位置细胞等三维导航细胞[2],这些细胞协同工作来绘制蝙蝠(群体)的三维空间认知地图。此外,近年来,群体智能决策“深度多智能体强化学习”技术[68]的出现和发展,为研究群体在与环境交互中习得智能决策提供了便捷计算架构。结合构建的类脑三维空间认知地图以及深度多智能体强化学习,开发三维群体环境感知、空间认知、面向目标导航一体化的端到端计算架构,即“三维集群类脑导航”,将是未来群体智能研究的热点。

2) 导航细胞自组织机制

澳大利亚国防科技集团Vladimir等[69]将哺乳动物海马体导航细胞自组织路径积分与导航机制融入哈密顿动力学集群控制模型融合的大规模无人机-无人车联合集群元认知监督导航/路径规划/动作决策一体化模型,此外,美国约翰霍金斯大学开展了基于大脑海马区导航细胞自组织机制的无人机集群感知/认知/路径规划与动作决策一体化探索研究。

如前文所述,昆虫个体自组织集群机制与哺乳动物大脑导航细胞自组织集群机制具有较好的互补对称性[9]。昆虫自组织集群感知、空间认知与导航模型具有较高的群体智能;导航细胞自组织集群导航神经计算机制得到了大量研究,具有稳定可靠的导航结果。因此,如何有效融合此二类自组织机制,发展“昆虫/导航细胞”自组织集群环境感知、空间认知与面向目标导航神经计算机制,是提升无人机密集集群导航性能的另一途径,也是作者团队重点研究的领域之一[70]。

4 类脑导航应用中存在的问题与挑战如前所述,类脑导航是一种大脑导航机理启发下的端到端推理学习型导航方法,借鉴动物大脑导航细胞自组织集群神经计算机制,利用AI技术实现从原始传感信息输入到导航行为决策的直接输出,形成具有自主环境感知、空间认知、路径规划与动作决策一体化能力的类脑导航模型。从当前类脑导航技术研究来看,应用于无人机密集集群系统主要存在类脑导航模型适用性、可解释性、精确性问题。

1) 类脑导航模型适用性。类脑导航模型是动物大脑导航细胞自组织连接结构及神经计算机制启发下的神经网络模型,虽然模型中的大部分连接由大脑结构预先定义,但其连接权值大多仍需采用学习的方法进行优化和确定,习得的模型在相近场景中具有较好适用性,但差别较大场景还有待进一步提高,需要解决模型迁移或快速自学习问题,这是类脑导航走向实际应用首要问题。

2) 类脑导航可解释性。类脑导航的3个过程:类脑环境感知、类脑空间认知以及面向目标类脑导航部分模型仍依赖黑箱建模的深度学习,当前的深度学习的可解释性还相对较差,若应用在实际无人机密集集群系统中出了问题很难找到问题的原因,也比较难排查,因此,如何引入更多的大脑导航脑区结构及信息处理机制,提高深度学习的可解释性具有重要的研究意义。

3) 类脑导航精确性。当前类脑导航还难以精确解算三维姿态、速度和位置等导航参数,较为成熟的研究是通过建立环境感知与行为决策之间的智能连接,解决“到哪去”以及“怎么去”等推理和决策问题。然而,当前阶段这些精确导航参数仍是无人机密集集群系统控制技术不可缺少的信息[71]。因此,目前类脑导航无法单独应用于无人机密集集群系统,需要传统导航算法的支持。

5 结论类脑导航技术初步形成了环境感知、空间认知与自主路径规划决策一体化的端到端技术特征,表现了一定的动物导航自主智能性,进一步将重点向与更多类脑智能行为耦合、神经形态类脑导航系统、以及类脑群体导航发展。类脑导航研究现状及未来发展主要研究内容如表 1所示,这些研究及其组合有望提高复杂工作环境下无人机密集集群导航的鲁棒性、准确性、实时响应动作、自主智能性以及计算效率。尽管目前类脑(群体)导航技术仅仅是对所发现的少数部分动物大脑导航机理借鉴,未能从系统层面模拟和借鉴动物大脑导航机理。随着脑与神经科学、人工智能、神经形态技术以及硬件技术的持续发展,类脑导航技术可以展现出更强大的功能和智能性,在无人机密集集群系统的应用中具有较大潜力。

| 分类 | 时间/年 | 单位 | 内容 | 文献 |

| 类脑环境感知 | 2003 | 加州大学伯克利分校 | 单眼、仿生陀螺仪、光流、U型仿生磁强计等仿生传感器设计 | [19] |

| 2018 | 谷歌DeepMind | 视觉抽象特征建图 | [29] | |

| 类脑空间认知 | 2009 | 哈佛大学 | 基于连续吸引子神经网络的网格细胞精确路径积分模型 | [34] |

| 2009 | 昆士兰科技大学 | 实现了RatSLAM系列类脑导航算法66 km城市级的车载测试验证 | [72] | |

| 2017 | 普林斯顿大学 | 位置细胞-网格细胞回路编码多种抽象任务特征空间 | [53] | |

| 面向目标导航 | 2018 | 谷歌DeepMind | 卷积神经网络/循环神经网络/和深度强化学习的类脑导航模型 | [38] |

| 类脑神经形态导航系统 | 2009 | 诺贝尔生理医学奖Edelman团队 | 提出了机器人类脑“BBD”神经形态设计架构 | [57] |

| 2016 | 加州大学欧文分校 | 基于类脑芯片TrueNorth的无人小车野外自主导航/决策与控制一体化 | [59] | |

| 2019 | 清华大学 | 基于混合异构类脑芯片“天机”的无人驾驶自行车类脑导航系统 | [62] | |

| 类脑群体导航 | 2018 | 以色列魏茨曼研究所 | 首次在蝙蝠大脑中发现了敏感同伴距离的“社交位置细胞” | [2] |

| 2015 | 开放大学 | 模拟蚂蚁正/负反馈信息素集群空间认知机制,采用脉冲神经网络实现了多机器人集群认知地图构建过程 | [63] |

| [1] | HONKANEN A, ADDEN A, DA SILVA FREITAS J, et al. The insect central complex and the neural basis of navigational strategies[J]. Journal of Experimental Biology, 2019, 222(S1): 1-15. |

| Click to display the text | |

| [2] | OMER D B, MAIMON S R, LAS L, et al. Social place-cells in the bat hippocampus[J]. Science, 2018, 359(6372): 218-224. |

| Click to display the text | |

| [3] | MAYA G S, LIORA L, YOSSI Y, et al. Spatial cognition in bats and rats:From sensory acquisition to multiscale maps and navigation[J]. Nature Reviews Neuroscience, 2015, 16(2): 94-108. |

| Click to display the text | |

| [4] | CHUNG S-J, PARANJAPE A A, DAMES P, et al. A survey on aerial swarm robotics[J]. IEEE Transactions on Robotics, 2018, 34(4): 837-855. |

| Click to display the text | |

| [5] |

熊骏, 熊智, 刘建业, 等.一种基于置信传播和协同信息筛选的无人机编队协同导航方法[C]//2018年无人载体导航与控制技术发展及应用学术研讨峰会.北京: 中国惯性技术学会, 2018: 42-46. XIONG J, XIONG Z, LIU J Y, et al. Cooperative navigation method based on belief propagation and cooperative message screening[C]//Proceedings of the Development and Application of Unmanned Vehicle Navigation and Control Technology. Beijing: Chinese Society of Inertial Technology, 2018: 42-46(in Chinese). |

| [6] |

许建新, 熊智, 陈明星, 等. 多无人机辅助定位信标的区域导航定位算法[J]. 航空学报, 2018, 39(10): 322172. XU J X, XIONG Z, CHEN M X, et al. Regional navigation algorithm assisted by locations of multi uavs[J]. Acta Aeronautica et Astronautica Sinica, 2018, 39(10): 322172. (in Chinese) |

| Cited By in Cnki (2) | Click to display the text | |

| [7] |

许晓伟, 赖际舟, 吕品, 等. 多无人机协同导航技术研究现状及进展[J]. 导航定位与授时, 2017, 4(4): 1-9. XU X W, LAI J Z, LV P, et al. a literature review on the research progress of the cooperative navigation technology for multiple UAVs[J]. Navigation Positioning & Timing, 2017, 4(4): 1-9. (in Chinese) |

| Cited By in Cnki (31) | Click to display the text | |

| [8] |

孙瑶洁, 熊智, 李文龙, 等. 无人机集群类脑导航系统综述[J]. 航空计算技术, 2019, 49(3): 130-134. SUN Y J, XIONG Z, LI W L, et al. Research status and progress of brain-like formation navigation system[J]. Aeronautical Computing Technique, 2019, 49(3): 130-134. (in Chinese) |

| Cited By in Cnki (1) | Click to display the text | |

| [9] | CHIALVO D R, MILLONAS M M. The biology and technology of intelligent autonomous agents[M]. Heidelberg: Springer, 1995: 439-450. |

| [10] | BUSH D, BARRY C, MANSON D, et al. Using grid cells for navigation[J]. Neuron, 2015, 87(3): 507-520. |

| Click to display the text | |

| [11] | YUAN M, TIAN B, SHIM V A, et al. An entorhinal-hippocampal model for simultaneous cognitive map building[C]//Proceedings of the Twenty-Ninth AAAI Conference on Artificial Intelligence, 2015. |

| [12] | EDVARDSEN V. Navigating by decoding grid cells[D]. Norway: Norwegian University of Science and Technology, 2019: 155-201. |

| [13] |

刘建业, 杨闯, 熊智, 等. 无人机类脑吸引子神经网络导航技术[J]. 导航定位与授时, 2019, 6(5): 52-60. LIU J Y, YANG C, XIONG Z, et al. Attractor neural network-based brain-inspired navigation technology for UAV[J]. Navigation Positioning & Timing, 2019, 6(5): 52-60. (in Chinese) |

| Cited By in Cnki (1) | Click to display the text | |

| [14] | HYMAN J M, ZILLI E A, PALEY A M, et al. Working memory performance correlates with prefrontal-hippocampal theta interactions but not with prefrontal neuron firing rates[J]. Frontiers in Integrative Neuroscience, 2010, 4(2): 1-13. |

| [15] | STEFFEN L, REICHARD D, WEINLAND J, et al. Neuromorphic stereo vision:A survey of bio-inspired sensors and algorithms[J]. Frontiers in Neurorobotics, 2019, 13(28): 1-20. |

| [16] | TIAN S, EBERT F, JAYARAMAN D, et al. Manipulation by feel: Touch-based control with deep predictive models[EB/OL]. (2019-03-11)[2019-07-09]. https://arxiv.org/abs/1903.04128. |

| [17] | HATWELL Y, STRERI A, GENTAZ E. Touching for knowing:Cognitive psychology of haptic manual perception[M]. Benjamins: John Benjamins Publishing, 2003: 1-20. |

| [18] | FEI F, TU Z, ZHANG J, et al. Learning extreme hummingbird maneuvers on flapping wing robots[EB/OL]. (2019-02-25)[2019-07-09].https://arxiv.org/abs/1902.09626. |

| [19] | WU W C, SCHENATO L, WOOD R J, et al. Biomimetic sensor suite for flight control of a micromechanical flying insect: Design and experimental results[C]//IEEE International Conference on Robotics & Automation. Piscataway, NJ: IEEE Press, 2003. |

| [20] | SRINIVASAN M V. An image-interpolation technique for the computation of optic flow and egomotion[J]. Biological Cybernetics, 1994, 71(5): 401-415. |

| Click to display the text | |

| [21] | VARGA M, ZUFFEREY J C, HEITZ G H M, et al. Evaluation of control strategies for fixed-wing drones following slow-moving ground agents[J]. Robotics & Autonomous Systems, 2015, 72: 285-294. |

| Click to display the text | |

| [22] | BASIRI M, SCHILL F S, FLOREANO D, et al. Audio-based localization for swarms of micro air vehicles[C]//IEEE International Conference on Robotics & Automation. Piscataway, NJ: IEEE Press, 2014: 4279-4734. |

| [23] | BAO X, GJORGIEVA E, SHANAHAN L K, et al. Grid-like neural representations support olfactory navigation of a two-dimensional odor space[J]. Neuron, 2019, 102(3): 1-10. |

| [24] | BADDELEY B, GRAHAM P, PHILIPPIDES A, et al. Holistic visual encoding of ant-like routes:Navigation without waypoints[J]. Adaptive Behavior, 2011, 19(1): 3-15. |

| Click to display the text | |

| [25] | CARTWRIGHT B A, COLLETT T S. Landmark maps for honeybees[J]. Biological Cybernetics, 1987, 57(1-2): 85-93. |

| Click to display the text | |

| [26] | MOORE T, ZIRNSAK M. Neural mechanisms of selective visual attention[J]. Annual Review of Neuroscience, 2017, 18(1): 193-222. |

| Click to display the text | |

| [27] | HUBEL D H, WIESEL T N. Receptive fields, binocular interaction and functional architecture in the cat's visual cortex[J]. The Journal of physiology, 1962, 160(1): 106-154. |

| Click to display the text | |

| [28] | MANCINI M, COSTANTE G, VALIGI P, et al. Towards domain independence for learning-based monocular depth estimation[J]. IEEE Robotics & Automation Letters, 2017, 2(3): 1-8. |

| [29] | ROSENBAUM D, BESSE F, VIOLA F, et al. Learning models for visual 3D localization with implicit mapping[EB/OL]. (2018-12-12)[2019-07-09]. https://arxiv.org/abs/1807.03149. |

| [30] | KAUFMANN E, LOQUERCIO A, RANFTL R, et al. Deep drone racing: Learning agile flight in dynamic environments[EB/OL]. (2018-10-09)[2019-07-09]. https://arxiv.org/abs/1806.08548. |

| [31] | PALMER S E. Modern theories of gestalt perception[J]. Mind & Language, 2010, 5(4): 289-323. |

| Click to display the text | |

| [32] | MCNAUGHTON B L, BATTAGLIA F P, OLE J, et al. Path integration and the neural basis of the cognitive map[J]. Nature Reviews Neuroscience, 2006, 7(8): 663-678. |

| Click to display the text | |

| [33] | TAMAS M, STAN F, KE C, et al. Bayesian integration of information in hippocampal place cells[J]. Plos One, 2015, 10(8): e0136128. |

| Click to display the text | |

| [34] | BURAK Y, FIETE I R. Accurate path integration in continuous attractor network models of grid cells[J]. PLoS Computational Biology, 2009, 5(2): 1-16. |

| Click to display the text | |

| [35] | BALL D, HEATH S, WILES J, et al. OpenRatSLAM:An open source brain-based SLAM system[J]. Autonomous Robots, 2013, 34(3): 149-176. |

| Click to display the text | |

| [36] | KANITSCHEIDER I, FIETE I. Training recurrent networks to generate hypotheses about how the brain solves hard navigation problems[C]//Proceedings of the Advances in Neural Information Processing Systems, 2017: 4529-4538. |

| [37] | CUEVA C J, WEI X X. Emergence of grid-like representations by training recurrent neural networks to perform spatial localization[EB/OL]. (2018-03-21)[2019-07-09]. https://arxiv.org/abs/1803.07770. |

| [38] | BANINO A, BARRY C, URIA B, et al. Vector-based navigation using grid-like representations in artificial agents[J]. Nature, 2018, 557(7705): 429. |

| Click to display the text | |

| [39] | HWU T, KRICHMAR J, ZOU X. A complete neuromorphic solution to outdoor navigation and path planning[C]//2017 IEEE International Symposium on Circuits and Systems. Piscataway, NJ: IEEE Press, 2017: 1-4. |

| [40] | TANG G, MICHMIZOS K P. Gridbot: An autonomous robot controlled by a spiking neural network mimicking the brain's navigational system[C]//International Conference on Neuromorphic Systems, 2018: 4-11. |

| [41] | BURGESS N, JACKSON A, HARTLEY T, et al. Predictions derived from modelling the hippocampal role in navigation[J]. Biological Cybernetics, 2000, 83(3): 301-312. |

| Click to display the text | |

| [42] | EDVARDSEN V. Goal-directed navigation based on path integration and decoding of grid cells in an artificial neural network[J]. Natural Computing, 2016, 18(1): 13-27. |

| [43] | GOLDSCHMIDT D, MANOONPONG P, DASGUPTA S. A neurocomputational model of goal-directed navigation in insect-inspired artificial agents[J]. Frontiers in Neurorobotics, 2017, 11(20): 1-17. |

| [44] | LAMPLE G, CHAPLOT D S. Playing FPS games with deep reinforcement learning[EB/OL]. (2018-01-29)[2019-07-09]. https://arxiv.org/abs/1609.05521v2. |

| [45] | MIROWSKI P, PASCANU R, VIOLA F, et al. Learning to navigate in complex environments[EB/OL]. (2017-01-13)[2019-07-09]. https://arxiv.org/abs/1611.03673v3. |

| [46] | ZHU Y, MOTTAGHI R, KOLVE E, et al. Target-driven visual navigation in indoor scenes using deep reinforcement learning[C]//IEEE International Conference on Robotics and Automation. Piscataway, NJ: IEEE Press, 2017: 3357-3364. |

| [47] | SAVINOV N, RAICHUK A, MARINIER R, et al. Episodic curiosity through reachability[EB/OL]. (2019-05-09)[2019-07-09]. https://arxiv.org/abs/1810.02274v5. |

| [48] | FINN C, RAJESWARAN A, KAKADE S, et al. Online meta-learning[EB/OL]. (2019-07-03)[2019-07-09]. https://arxiv.org/abs/1902.08438v4. |

| [49] | LOQUERCIO A, MAQUEDA A I, BLANCO C R D, et al. Dronet:Learning to fly by driving[J]. IEEE Robotics & Automation Letters, 2018, 3(2): 1088-1095. |

| [50] | TOBIN J, FONG R, RAY A, et al. Domain randomization for transferring deep neural networks from simulation to the real world[C]//2017 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). Piscataway, NJ: IEEE Press, 2017. |

| [51] | MIROWSKI P, GRIMES M K, MALINOWSKI M, et al. Learning to Navigate in Cities Without a Map[EB/OL]. (2019-01-10)[2019-07-09]. https://arxiv.org/abs/1804.00168v3. |

| [52] | MADL T, FRANKLIN S, CHEN K, et al. A computational cognitive framework of spatial memory in brains and robots[J]. Cognitive Systems Research, 2018, 47: 147-172. |

| Click to display the text | |

| [53] | ARONOV D, NEVERS R, TANK D W. Mapping of a non-spatial dimension by the hippocampal-entorhinal circuit[J]. Nature, 2017, 543(7647): 719. |

| Click to display the text | |

| [54] | QUIROGA R Q. Concept cells:The building blocks of declarative memory functions[J]. Nature Reviews Neuroscience, 2012, 13(8): 587-597. |

| Click to display the text | |

| [55] | BICANSKI A, BURGESS N. A computational model of visual recognition memory via grid cells[J]. Current Biology, 2019, 29(3): 979-990. |

| Click to display the text | |

| [56] | TANG H, YAN R, TAN K C. Cognitive navigation by neuro-inspired localization, mapping, and episodic memory[J]. IEEE Transactions on Cognitive and Developmental Systems, 2018, 10(3): 751-761. |

| Click to display the text | |

| [57] | FLEISCHER J G, EDELMAN G M. Brain-based devices[J]. IEEE Robotics & Automation Magazine, 2009, 16(3): 33-41. |

| Click to display the text | |

| [58] | SABO C, CHISHOLM R, PETTERSON A, et al. A lightweight, inexpensive robotic system for insect vision[J]. Arthropod Structure & Development, 2017, 46(5): 689-702. |

| Click to display the text | |

| [59] | HWU T, ISBELL J, OROS N, et al. A self-driving robot using deep convolutional neural networks on neuromorphic hardware[C]//2017 International Joint Conference on Neural Networks. Piscataway, NJ: IEEE Press, 2017: 635-641. |

| [60] | KREISER R, PIENROJ P, RENNER A, et al. Pose estimation and map formation with spiking neural networks: towards neuromorphic SLAM[C]//2018 IEEE/RSJ International Conference on Intelligent Robots and Systems. Piscataway, NJ: IEEE Press, 2018: 2159-2166. |

| [61] | PALOSSI D, CONTI F, BENINI L. An open source and open hardware deep learning-powered visual navigation engine for autonomous nano-UAVs[EB/OL]. (2019-05-10)[2019-07-09]. https://arxiv.org/abs/1905.04166. |

| [62] | PEI J, DENG L, SONG S, et al. Towards artificial general intelligence with hybrid Tianjic chip architecture[J]. Nature, 2019, 572(7767): 106. |

| Click to display the text | |

| [63] | JIMENEZ R C, SOUSA R D, JOHNSON J H, et al. A model for foraging ants, controlled by spiking neural networks and double pheromones[EB/OL]. (2015-09-18)[2019-07-09]. https://arxiv.org/abs/1507.08467v3. |

| [64] | BONNET F, MILLS R, SZOPEK M, et al. Robots mediating interactions between animals for interspecies collective behaviors[J]. Science, 2019, 4(28): eaau7897. |

| [65] | DUVELLE É, JEFFERY K J. Social spaces:Place cells represent the locations of others[J]. Current Biology, 2018, 28(6): 271-273. |

| Click to display the text | |

| [66] | GEVA-SAGIV M, ROMANI S, LAS L, et al. Hippocampal global remapping for different sensory modalities in flying bats[J]. Nature Neuroscience, 2016, 19(7): 952. |

| Click to display the text | |

| [67] | WOHLGEMUTH M W, CHAO I, MOSS C F. 3D Hippocampal place field dynamics in free-flying echolocating bats[J]. Frontiers in Cellular Neuroscience, 2018, 12(270): 1-16. |

| [68] | NGUYEN T T, NGUYEN N D, NAHAVANDI S. Deep reinforcement learning for multi-agent systems: A review of challenges, solutions and applications[EB/OL]. (2019-02-06)[2019-07-09]. https://arxiv.org/abs/1812.11794v2. |

| [69] | VLADIMIR G I, DARRYN J R. Cognitive supervisor for an autonomous swarm of robots[J]. Intelligent Control and Automation, 2017, 8(01): 44-65. |

| Click to display the text | |

| [70] |

熊智, 刘建业.智能自主无人机多源信息融合导航理论与类脑导航技术发展建议[C]//科技2035-导航新技术与学科发展论坛, 2019. XIONG Z, LIU J Y. Multi-source information fusion navigation theory of intelligent autonomous UAV and development suggestions of brain-like navigation technology[C]//Science and Technology 2035-Forum on New Navigation Technologies, 2019(in Chinese). |

| [71] |

张佳龙, 闫建国, 张普. 基于反步推演法的多机编队队形重构控制研究[J]. 航空学报, 2019, 40(11): 323177. ZHANG J L, YAN J G, ZHANG P. Study on multi-UAV formation forming control based on backing-stepping method[J]. Acta Aeronautica et Astronautica Sinica, 2019, 40(11): 323177. (in Chinese) |

| Cited By in Cnki (1) | Click to display the text | |

| [72] | MILFORD M, WYETH G. Mapping a suburb with a single camera using a biologically inspired SLAM system[J]. IEEE Transactions on Robotics, 2008, 24(5): 1038-1053. |

| Click to display the text |